SGI Tech Specs – Was steckt in der Indigo? - Teil 2

Zusammenfassung Teil 1 #

Im ersten Teil hat Alex erzählt, wie eine SGI Workstation von der Resterampe der Telekom den Weg zu ihm fand und jahrelang als Server im Flur stand. Nun schauen wir uns an, was technisch in der Indigo steckt.

Was erwartet uns? #

Die SGI läuft – aber was erwartet uns eigentlich, wenn man so ein System einschaltet? War der Hype um die Silicon Graphics Workstations gerechtfertigt, oder bescherte mir dieses 3D-Wunderwerk zu Unrecht feuchte Träume?

Zur Einordnung: Die SGI Indigo wurde 1991 vorgestellt und war bis 1994 in verschiedenen Versionen am Markt. Zu dieser Zeit waren die 3D-Vorzeigepflichten am PC Spiele wie Doom oder Elite 2 am Amiga. Damals waren PCs erstmals leistungsfähig genug, um Texturen halbwegs flüssig auf Flächen im Raum abzubilden. Für Doom mussten gerade einmal 500 Polygone berechnet und texturiert werden; bei aufwendigeren Titeln wie Peter Molyneux’ Grafikblender Magic Carpet konnten es auch schon mal mehrere Tausend Polygone sein. Die Intel-486-Prozessoren waren dabei durchaus leistungsfähig und konnten sich bei den reinen Operationen pro Sekunde fast mit dem MIPS R4000 messen. Naja, zumindest auf dem Papier.

Das Erwachen der Macht: Booten mit Stil #

Wer in den 90ern einen PC startete, erlebte meist das Gleiche: Ein kurzes, trockenes „Beep“ vom internen Piezo-Lautsprecher, gefolgt von weißem Text auf schwarzem Grund, der mühsam den mickrigen Arbeitsspeicher hochzählte. Das war zweckmäßig, aber alles andere als geil.

Schaltete man hingegen die SGI Indigo ein, begriff man sofort, dass man vor einer anderen Geräteklasse saß.

Die Fanfare statt dem „Beep“ #

Der erste große Unterschied war akustischer Natur. Während der PC-Lautsprecher (der berühmte „PC Speaker“) eigentlich nur dazu da war, Fehlersignale in monotonen Rechteckschwingungen auszuspucken, besaß die Indigo ein echtes Audiosystem mit einem hochwertigen, eingebauten Lautsprecher.

Statt eines nervigen Piepsens ertönt eine satte, fast schon feierliche Fanfare als Audio-Sample. Es war das akustische Signal: "Haltet euere Hüte fest, dieses System frisst PCs zum Frühstück"

Grafik schon vor dem Betriebssystem #

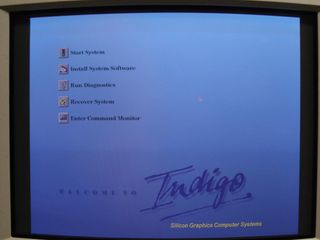

Während der PC noch im Textmodus verharrte, präsentierte die Indigo bereits Sekunden nach dem Einschalten ein grafisches Wartungsmenü (das sogenannte PROM-Menü). Hier konnte man mit der Maus navigieren, noch bevor überhaupt ein Betriebssystem geladen war – ein Komfort, den PC-Nutzer erst viele Jahre später mit UEFI-Bios-Oberflächen kennenlernen sollten.

Aber die schicke Optik ist nur die Werbung vor dem Hauptfilm. Unter dem lila Gehäuse steckte brachiale Power, PCs um Jahre voraus war. Werfen wir einen Blick tieder ins Gerät.

Geschwindigkeit und Genauigkeit #

Ein Intel 486 lag damals bei etwa 50 Mio. Operationen pro Sekunde (MIPS), der R4000 mit 100 Mio. war da zumindest noch in Sichtweite. Das verhalf dem PC in Alltagsanwendungen zwar zu einer ordentlichen Performance, doch die FPU (Floating Point Unit) auf dem CPU-Board der SGI war bereits um den Faktor 3 schneller.

Das lag vor allem daran, dass die FPU im PC oder Amiga für normale Anwendungen kaum eine Rolle spielte. Jedoch dort, wo man komplexe Divisionen für die präzise Darstellung von Punkten im Raum benötigt, ist sie unverzichtbar. Willkommen in der Welt von CGI. Während der PC-Prozessor 3D Berechnungen mühsam auf der CPU miterledigen musste, war bei der SGI bereits eine dedizierte 3D-Grafikkarte dafür zuständig. Die XS-Grafik unserer Workstation war ein Mittelklassemodell und bereits achtmal schneller als damalige PC-Lösungen in Gleitkommaberechnung – die Top-Variante sogar sechzehnmal. Auf solche Werte kamen PCs erst mit dem Pentium III im Jahr 1999, also satte sieben Jahre später.

Besonderheiten #

Abseits der reinen Rechenpower gab es noch weitere Punkte, in denen die SGI den klassischen PC wie ein Relikt wirken ließ. Während die frühen Indigo-Modelle mit dem MIPS R3000 noch in der 32-Bit-Welt zu Hause waren, brachten die Modelle ab 1991 mit R4000-Prozessoren echtes 64-Bit-Computing mit – und das 12 Jahre, bevor das im PC-Sektor mit dem Athlon 64 überhaupt ein Thema wurde.

Dieser Architektur-Sprung ermöglichte einen massiven Speicherausbau von bis zu 384 MB RAM. Zum Vergleich: In unserer Indigo stecken aktuell 112 MB – eine Menge, die 1991 absolut astronomisch war, wenn man bedenkt, dass ein typischer High-End-Gaming-PC jener Zeit mit gerade einmal 4 bis 8 MB auskommen musste.

Auch visuell lagen Welten dazwischen: Während sich PC-User mit der VGA-Auflösung von 640x480 Pixeln bei 256 Farben begnügten, feuerte die SGI standardmäßig knackscharfe 1280x1024 Pixel in voller 24-Bit-Farbtiefe (True Color) auf den Schirm.

Der Z-Buffer: 3D-Sortier-Maschine #

Stell dir vor, ein Computer muss in Millisekunden entscheiden, welches Objekt im 3D-Raum vor einem anderen steht. Frühe 3D-Spiele umschifften dieses Problem meist, indem sie lediglich durchsichtige Drahtgittermodelle berechneten. Sobald jedoch ausgefüllte Polygone ins Spiel kamen, musste ein herkömmlicher PC wie ein Maler arbeiten: Sie sortierten alle Objekte im Kopf mühsam von hinten nach vorne und zeichnete sie nacheinander (der sogenannte „Painter’s Algorithm“).

Da dieser Prozess für Echtzeit-Grafik viel zu langsam war, behalfen sich Entwickler mit fehleranfälligen Tricks. Die Folge: Objekte flackerten unschön, weil die Tiefenberechnung zu ungenau war oder Objekte fälschlicherweise in eine Ebene gelegt wurden. Ein klassisches Beispiel ist das sogenannte „Z-Fighting“: Wenn zwei Texturen – etwa ein Poster an einer Wand – wild gegeneinander flimmern, weil die Hardware nicht entscheiden kann, welche Ebene eigentlich vorne liegt.

Die SGI Indigo löste dieses Dilemma mit purer Genauigkeit und Hardware. Sie spendierte jedem einzelnen Bildpunkt auf dem Monitor eine exakte Tiefeninformation: den Z-Wert als 24-Bit-Zahl. Bevor die Hardware einen neuen Punkt zeichnete, stellte sie die alles entscheidende Frage: „Liegt dieser Punkt näher am Betrachter als das, was bereits dort gezeichnet wurde?“ Nur der vorderste Punkt schaffte es am Ende auf den Schirm. Das Ergebnis war eine perfekte, fehlerfreie Tiefendarstellung, ganz egal, wie komplex oder überladen die Szene auch war.

Wem das zu technisch war, hier die Kurzfassung:

Die SGI besaß ein tiefes, hardwareseitiges Verständnis von Raum und Geometrie – eine Fähigkeit, die PCs erst mit den 3D-Beschleunigern um die Jahrtausendwende lernten.

Selbst die legendären 3dfx-Karten beherrschten diese geometrische Präzision in dieser Form noch nicht; erst NVIDIA-Grafikkarten brachten 1999 mit Transform & Lighting (T&L) eine vergleichbare Technologie auf den heimischen PC.

Fortsetzung folgt... #

← Teil 1: Meine eigene SGI Workstation

→ Teil 3: Betriebssystem, Anwendungen und Home-Brew-Szene

Vielen Dank an Vereinsmitglied Alex für die ausführliche Dokumentation!